KI in Industrie : AI-Pionier Hochreiter: Neuronale Netze als neue Welten

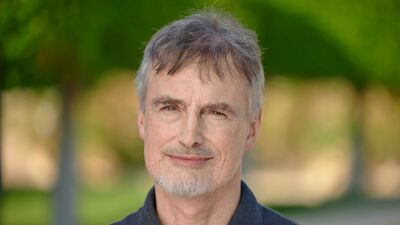

Wegbereiter neuronaler Netze: Sepp Hochreiter

- © YouTube/ der brutkastenEs war Dezember 2021, als wir mit Sepp Hochreiter unsere traditionelle „KI in der Industrie – Weihnachtsfolge“ aufnahmen. Wir bitten unsere Gäste immer darum, ihre Benachrichtigungen von Outlook, Slack und Co. auszuschalten, damit der Signalton nicht mit aufgenommen wird. Hochreiter hielt sich nicht an unsere Bitte – zum Glück. Wir unterbrachen die Aufnahme kurz.

Der Pionier im Interview: Glauben Sie an den freien Willen, Herr Hochreiter?

„Der Jürgen schreibt gerade und fragt, ob wir nächstes Jahr 25 Jahre LSTM (Long short-term memory) feiern wollen.“ Wir wollten unbedingt, dachten wir uns, denn die Erfindung der beiden AI-Vordenker hat vieles verändert: LSTM ermöglicht im Gegensatz zu herkömmlichen rekurrenten neuronalen Netzen eine Art Erinnerung an frühere Erfahrungen: Ein Kurzzeitgedächtnis, das lange anhält.

Hochreiter war in den 80er und 90er Jahren des letzten Jahrhunderts Student an der Technischen Universität in München. Das Informatikstudium langweilte ihn. Er lernte den Hochschullehrer Schmidhuber kennen und schnell besserte sich seine Laune. Von „neuen Welten“, spricht Hochreiter heute, wenn er an die ersten Forschungsfragen zu neuronalen Netzen zurückdenkt. Hochreiter bekommt eine Praktikanten-Stelle. Schmidhuber lobt heute die Brillanz des jungen Bayern.

Der LSTM-Algorithmus: auf einmal Aufmerksamkeit

Die ersten neuronalen Netze stammen aus den 60er Jahren. Es stellte sich dann aber heraus, dass die nicht so richtig gut funktionieren, wenn sie tiefe Probleme lösen sollen. Die Systeme konnten sich nicht merken, was vor langer Zeit vorgelesen wurde und damit später auch nicht mehr einordnen. Es braucht das Wissen aus der Vergangenheit, um in der Zukunft richtig zu handeln. Schmidhuber forschte mit einem Team junger Wissenschaftler an dem Thema. Der Durchbruch kam dann aber erst mit Hochreiters Diplomarbeit Anfang der 90er Jahre.

Dieses Interview könnte Sie auch interessieren: "Den Systemen fehlt das Weltverständnis"

Der heutige Professor aus Linz entdeckt in seiner Arbeit das Vanishing Gradient Problem. Das Problem des verschwindenden Gradienten ist eine der Hauptursachen, warum es anfänglich unmöglich war, tiefe Netze zu trainieren. „Ich habe da alles mit Print F auf den Bildschirm oder in eine Datei ausgegeben. Und habe mir dann angeschaut: Wie sind die Ableitungen, wenn ich dieses Gewicht vom neuronalen Netz, diese synaptische Verbindung verändern möchte, warum macht das Netzwerk das nicht?

2009 gewannen Schmidhuber und ein Team von jungen Wissenschaftlern die ersten Wettbewerbe mit dem LSTM-Algorithmus. Sie entwickelten ihn immer weiter. Und auf einmal wurden die großen Tech-Unternehmen auf die Erfindung aufmerksam. 2015 kam der kommerzielle Durchbruch. Google gehörte zu den ersten Anwendern. Mittlerweile ist das Paper von Schmidhuber und Hochreiter eines der meist zitieren wissenschaftlichen Abhandlungen im Bereich Informatik. Facebook erkannte die Chance mit LSTM Übersetzungen einfach zu ermöglichen. Und die Industrie? Nutzt den Algorithmus für die OEE-Optimierung in der Fertigung.

Dieser Beitrag wurde erstmals Februar 2022 veröffentlicht.